[이데일리] '전력 먹는 하마' AI칩, 저전력 메모리가 뜬다

컨텐츠 정보

- 519 조회

- 목록

본문

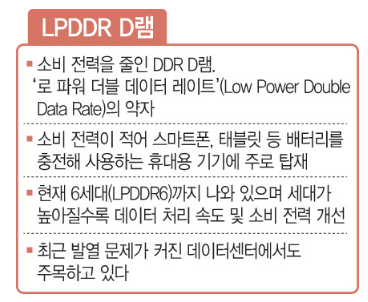

[이데일리 김정남 김응열 기자] 인공지능(AI) 시대 들어 저전력 메모리의 중요성이 급부상하고 있다. AI 가속기, AI 스마트폰용 애플리케이션 프로세서(AP) 등 AI 반도체에 적용하는 메모리가 속도와 용량만큼이나 전력 효율이 최우선으로 여겨지고 있는 것이다. 삼성전자와 SK하이닉스가 저전력 LPDDR D램 확대에 드라이브를 거는 것은 이같은 이유에서다.

16일 시장조사업체 마켓앤마켓에 따르면 별도의 인터넷 연결 없이 기기 자체에서 AI 모델에 필요한 연산을 수행하는 온디바이스 AI 시장은 지난 2022년 185억달러(약 25조6000억원)에서 오는 2030년 1739억달러(약 250조원)로 성장할 것으로 추정된다. 연평균 성장률 전망치가 37%에 달한다.

온디바이스 AI 시대 들어 가장 중요한 것은 저전력이다. 스마트폰, 태블릿PC 등이 자체적으로 AI 연산을 할 때 배터리 소모를 최소화해야 하기 때문이다. 이때 기기에 탑재되는 AI 칩에 저전력 메모리를 쓸 경우 높은 전력 효율을 지원할 수 있는 것이다. AI 칩은 막대한 데이터를 처리하는 과정에서 전력 소모가 커서 ‘전력 먹는 하마’로 불린다.

삼성전자는 이날 대만 미디어텍과 업계 최고 속도인 10.7Gbps LPDDR5X D램 동작 검증을 완료했다고 발표했는데, 이는 급성장하는 수요에 대응하고자 여러 모바일 AP 설계업체들과 협업을 진행하고 있는 일환이다. 동작 검증을 마친 미디어텍 제품은 하반기 출시 예정인 플래그십 모바일 AP ‘디멘시티 9400’이다. 삼성전자 D램이 미디어텍 AP에 탑재돼 정상 작동했다는 뜻이다. 삼성전자 신제품은 이전 세대 대비 소비 전력을 25% 이상 개선했다.

김양팽 산업연구원 전문연구원은 “지금 온디바이스 AI향 메모리는 고대역폭메모리(HBM)와는 또 다른 저전력 경량화가 필요하다”고 했다. 이규복 한국전자기술연구원(KETI) 연구부원장은 “삼성전자가 미디어텍을 잡는다면 다른 고객사들과도 LPDDR5X 협의를 수월하게 할 수 있을 것”이라고 말했다.

LPDDR D램은 전력 효율의 중요성이 부각되면서 기존 모바일 외에 데이터센터 등 서버 시장에서도 주목받고 있다. 에너지 절감 측면에서다. 특히 전력 소모가 감소하면 그만큼 발열이 줄어들 수 있는 만큼 데이터센터 역시 저전력이 중요한 특성으로 꼽히고 있다. 업계 한 고위인사는 “업계 최대 화두 중 하나인 전력 공급 부족이 현실화하면 저전력 메모리는 더 중요해질 것”이라고 했다.

SK하이닉스도 LPDDR D램에 집중하고 있기는 마찬가지다. SK하이닉스는 지난해 말 모바일용 LPDDR5T를 상용화해 고객사에 공급하기 시작했다. 이 제품은 초당 9.6Gbs의 데이터를 전송할 수 있다.

김정남([email protected])

.jpg)

.jpg)